È tempo di campagna elettorale e tornano i comizi in piazza, i politici sgomitano per ritagliarsi uno spazio nei talk show televisivi, ma da circa un decennio a questa parte la propaganda politica ha trovato terreno fertile in una nuova immensa arena: i social network. Sempre più persone nel mondo, soprattutto le nuove generazioni, infatti, li stanno scegliendo come fonte primaria di informazione1.

Abbiamo già parlato, in articoli precedenti, di come le piattaforme social più popolari raccolgano dati, tracciando la nostra navigazione sulle stesse. La somma dei dati e metadati ottenuti in questo modo, permette di profilare l’utente e di ricavare informazioni, tra le altre cose, riguardo alle sue abitudini, ai suoi interessi e alle sue inclinazioni politiche. Da ciò si può comprendere perché le forze politiche si stiano affidando sempre di più a questi strumenti e alle loro enormi potenzialità.

Per fare questo si affidano spesso ad aziende specializzate in analisi di dati, capaci di individuare i profili più sensibili a un particolare tipo di annuncio mirato2, attraverso modelli predittivi come quello elaborato da Michal Kosinski, ricercatore e psicologo, descritto nello studio “Private traits and attributes are predictable from digital records of human behavior”3, pubblicato su Pnas nel 2013.

La particolarità di questi metodi – e la loro efficacia – nasce dalla necessità di categorizzare la personalità dell’utente non solo attraverso le informazioni che l’utente sceglie di condividere, ma attraverso i metadati, cioè il modo in cui l’utente interagisce con la piattaforma e sceglie di esprimersi. Come scrive Shoshana Zuboff, professoressa americana e business analyst di Harvard, ne Il capitalismo della sorveglianza “Non conta che cosa c’è nelle nostre frasi, ma la loro lunghezza e complessità; non che cosa elenchiamo, ma il fatto che facciamo un elenco; non la foto che postiamo, ma il filtro o la saturazione che abbiamo scelto; non cosa riveliamo, ma il modo in cui lo condividiamo o meno; non dove abbiamo deciso di incontrarci con gli amici, ma come lo faremo….”4

I CASI CELEBRI

Questa metodologia è stata al centro di un noto scandalo: quello di Cambridge Analytica. Si è trattato di una società di analisi dati, specializzata in metodologie per effettuare del micro-targeting aggressivo di natura politica. È stata accusata di aver utilizzato illecitamente dati raccolti attraverso Facebook, in seguito al “pentimento” di Chris Wylie 5. Sempre Zuboff scrive che l’obiettivo era “la micro targetizazione comportamentale. […] Influenzare gli elettori basandosi non sui loro dati demografici, ma sulle loro personalità“6.

Negli ultimi anni sono molti i casi documentati che hanno utilizzato questo approccio per cercare di influenzare le elezioni politiche. Anche se di solito non è facile avere una stima quantitativa di quanto siano risultate efficaci, anche perché spesso i social si comportano come scatole nere in cui non è possibile sapere precisamente come agiscono gli algoritmi, diverse elezioni sono state oggetto di studi, che hanno evidenziato come la propaganda su questi mezzi abbia avuto un ruolo rilevante7. Il caso più eclatante è probabilmente quello che ha permesso a Donald Trump di avere la strada spianata per la corsa alla presidenza degli Stati Uniti nel 2016, rivolgendosi a Cambridge Analytica. In questa occasione, le istanze del suprematismo bianco sono state spinte anche tramite l’uso di bot e account falsi, molto spesso accompagnate da una buona dose di fake news8. Si sospetta anche l’interferenza della Russian Internet Research, un gruppo di hacker russi vicini al cremlino, specializzati nell’utilizzo di account “troll”, con l’intento di creare divisione all’interno della nazione americana 9 10. Questo ha obbligato le piattaforme a prendere provvedimenti11, che non hanno però impedito il ripresentarsi di scenari simili nelle elezioni del 202012, culminati con l’assalto di Capitol Hill, organizzato sempre attraverso i social13.

Anche in occasione del voto sulla Brexit è stato fatto largo uso della profilazione degli utenti e molte persone sono entrate in contatto con vere e proprie “bufale” e disinformazione sui social prima di prendere una decisione14 15.

Non serve però andare troppo lontano, anche in Italia abbiamo avuto esempi di come si siano sfruttati i meccanismi dei social per agevolare la diffusione di contenuti che spesso mirano alla pancia delle persone e ottenere consenso. Si pensi alla famigerata “Bestia”, la macchina della propaganda adottata dalla Lega di Salvini. La strategia era basata sia sulla profilazione16 , sia su un team di professionisti continuamente dedicato ad intercettare il sentimento degli elettori, cogliendo le opportunità per fornire agli utenti, soprattutto quelli che si mostravano indecisi, contenuti basati sulle loro probabili richieste. Per rendere più polarizzata l’interazione, non sono mancati post denigratori nei confronti degli avversari, così come il filtraggio dei commenti, non permettendo l’uso di parole chiave che potessero essere utilizzate dagli oppositori. Si è sfruttata anche la mobilitazione dei follower più fedeli, spinti ad azioni per rendere virali i post17. Va detto che pratiche simili, in tutto o in parte, sono state adottate anche da altri partiti, di diversi schieramenti politici18.

Si potrebbero citare molti altri esempi di come possano essere sfruttati i social per fini propagandistici, non solo per vincere le elezioni, ma, in certi casi, anche per supportare comportamenti discriminatori verso una particolare categoria di persone. È il caso, ad esempio, del popolo Rohingya, le cui feroci persecuzioni sono, come dichiarato dall’ONU, assimilabili a una vera e propria pulizia etnica e la stessa ONU ha accusato Facebook di avere avuto un ruolo determinante nel veicolare contenuti d’odio contro questa minoranza19

NEGAZIONISIMO E DISINFORMAZIONE

Veniamo al punto che interessa particolarmente a chi vuole comunicare la crisi climatica sui social. Uno dei passi importanti per arrivare a una vera transizione ecologica è creare consapevolezza e consenso tra i cittadini sul fatto che far fronte alla crisi climatica sia una priorità e si vorrebbe quindi comunicare tale urgenza attraverso fatti ed evidenze scientifiche. Il problema nasce già nel momento in cui un post pubblicato sui social non ha necessariamente lo stesso peso rispetto ad un altro20 21. Questo perché gli algoritmi delle piattaforme mettono in evidenza i contenuti che rispettano certe caratteristiche, tra le quali, la fondatezza di quanto affermato non è rilevante.

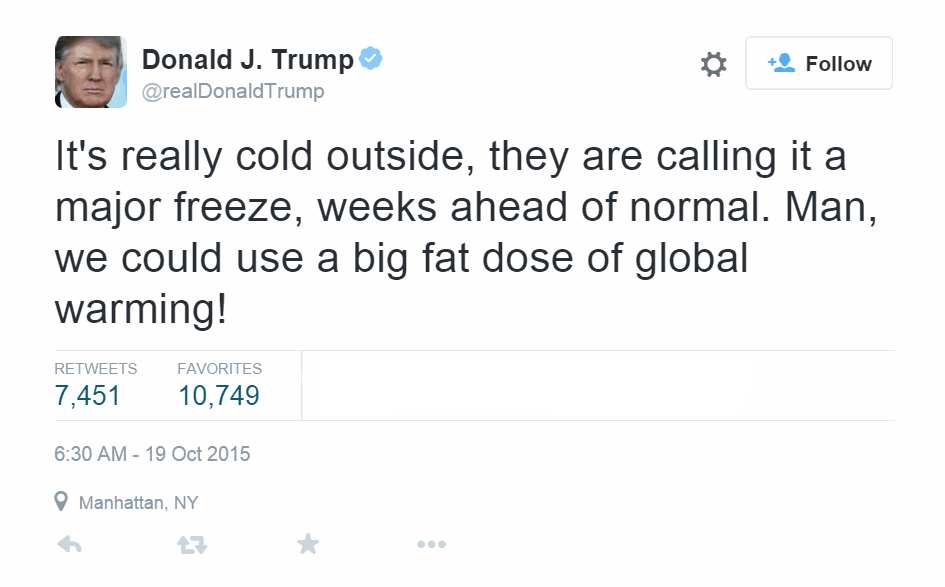

Lo scopo dell’algoritmo, infatti, è quello di permettere ai proprietari della piattaforma di raggiungere la massima monetizzazione possibile, quindi vengono favoriti quei contenuti che generano maggior numero di interazioni e che tengano l’utente incollato allo schermo. Tra questi contenuti, vengono premiati quelli che colpiscono l’emotività dell’utente, spesso però questi sono divisivi e polarizzanti, sfociano nell’hate speech e non aiutano a costruire un dibattito sano e costruttivo su temi complessi. Se poi ciò che viene condiviso è una fake news, presentata in modo da colpire la pancia di una determinata categoria di persone, questa potrebbe anche essere più pervasiva di un contenuto aderente alla realtà o persino di un’evidenza scientifica22. Un post che nega il cambiamento climatico, in questo contesto può avere peso equivalente o maggiore di uno che cita correttamente ciò che afferma la comunità scientifica. Inoltre, a volte, si riportano le voci di presunti esperti o si da spazio a gruppi isolati di scienziati, magari in conflitto d’interesse , che ad esempio negano l’origine antropica del cambiamento climatico, (casi simili a quelli descritti nel libro “Mercanti di dubbi” di Naomi Oreskes ed Erik Conway23). In questo modo si da’ l’impressione che ci sia un effettivo dibattito tra chi studia certi fenomeni, anche laddove la comunità scientifica è praticamente concorde, dimenticando che il vero dibattito scientifico si fa rispondendo a studi con altri studi e non con dichiarazioni sui mass media. Affinchè i politici prendano misure sulla crisi climatica è necessario che la gente sia informata e richieda dei programmi seri con l’obiettivo di azioni al riguardo. Cosa che può in certi casi diventare difficoltosa per via delle insinuazioni negazioniste, fatte con l’uso di disinformazione e fake news e spesso pagate da società fossili24 25.

Il fatto, poi, che le piattaforme spesso cercano di mantenere l’attenzione su di esse e a creare un contesto in cui l’utente è portato a scrollare velocemente le notizie sul suo feed, non invoglia il lettore a soffermarsi per verificare e approfondire una notizia quando gli viene presentata. Inoltre è più probabile che i post più in linea con le idee dell’utente vengano mostrati in cima al feed dell’utente, creando le cosiddette echo chambers 26. I contenuti informativi e divulgativi, quindi, rimangono in prevalenza confinati a chi è già predisposto a riceverli, scoraggiando l’utente a seguire una pluralità di voci.

A tutto ciò si aggiunge il fatto che, come detto all’inizio dell’articolo, partiti politici o grandi compagnie possono pagare società di analisi per far arrivare contenuti mirati a un determinato gruppo di utenti, moltiplicando così gli effetti finora descritti. La somma di tutto questo ci porta a dire che in alcune piattaforme la realtà può apparire distorta, come scriviamo nella pagina canali social.

COSA POSSIAMO FARE?

Alcune problematiche legate alla polarizzazione e alla disinformazione sono sempre stati presenti durante il periodo della campagna elettorale, anche se i social ne hanno amplificato il raggio d’azione e hanno fornito nuovi strumenti per una propaganda mirata più efficace. Con questo non si vuole negare le grandi potenzialità che hanno i social network in generale per collegare un grande numero di persone intorno al mondo e parlare di tematiche globali. Fridays For Future stesso deve ai social gran parte della sua forza mediatica. Il nostro intento è quello di creare consapevolezza su quali possono essere i meccanismi che operano all’interno delle piattaforme più conosciute e provare ad evidenziare problematiche e valutare accorgimenti affinché il mondo del web sia sempre di più un posto migliore. Questo andrebbe fatto anche al fine di una più efficace comunicazione della crisi climatica, oltre che per limitare le pratiche finora descritte.

In quest’ottica, un primo passo è appunto quello di conoscere come funziona il processo di comunicazione sulle piattaforme, parlarne e fare pressione affinché si prendano provvedimenti per contrastare la disinformazione e gli abusi in termini di privacy e profilazione sulle piattaforme. Ad esempio, dopo che sono emersi i tentativi di manipolare l’elettorato tramite i social, le stesse piattaforme hanno dovuto porre dei rimedi, ad esempio mettendo un’etichetta quando una notizia condivisa è una probabile fake news. Si tratta però spesso di soluzioni che tamponano il problema, senza andare alla radice e arginare veramente i meccanismi più problematici27.

Una risposta più incisiva può essere quella di ripensare i modelli con cui strutturiamo i social network, senza l’utilizzo di profilazione o di algoritmi che intervengono sull’ordine con cui riceviamo le notizie. Anche in questo caso ci sentiamo di suggerire alternative aperte e senza profilazione come le piattaforme offerte dal fediverso28 dove abbiamo un profilo Mastodon e Peertube. Anche se alcune alternative possano apparire ancora macchinose ai più, il fatto di interessarsi e creare un dibatto su come vorremmo che siano i social del futuro, ci permette di fare passi avanti verso progetti sempre più concreti29 30.

Se volete scoprire il lavoro che abbiamo fatto in campo digitale visitate questa pagina, in cui troverete altri articoli in merito alla sostenibilità digitale e in cui spieghiamo anche le scelte fatte per rendere sostenibile il nostro sito. Un esempio è l’implementazione degli eventi attraverso Mobilizon, come alternativa agli eventi Facebook, per registrare gli scioperi di Fridays For Future Italia.